2025年10月,我前往德国慕尼黑参加 ICCAD 2025,并在会议上汇报了自己的论文《LLM-Augmented Multi-Modal Fusion for SoC Design Space Exploration》。对我来说,这次出行最重要的意义,不只是完成一次国际会议报告,更是一次非常具体的学术现场体验:把自己长期投入的问题带到国际同行面前,接受讨论、质疑和反馈,也借此更清楚地认识自己工作的价值和局限。

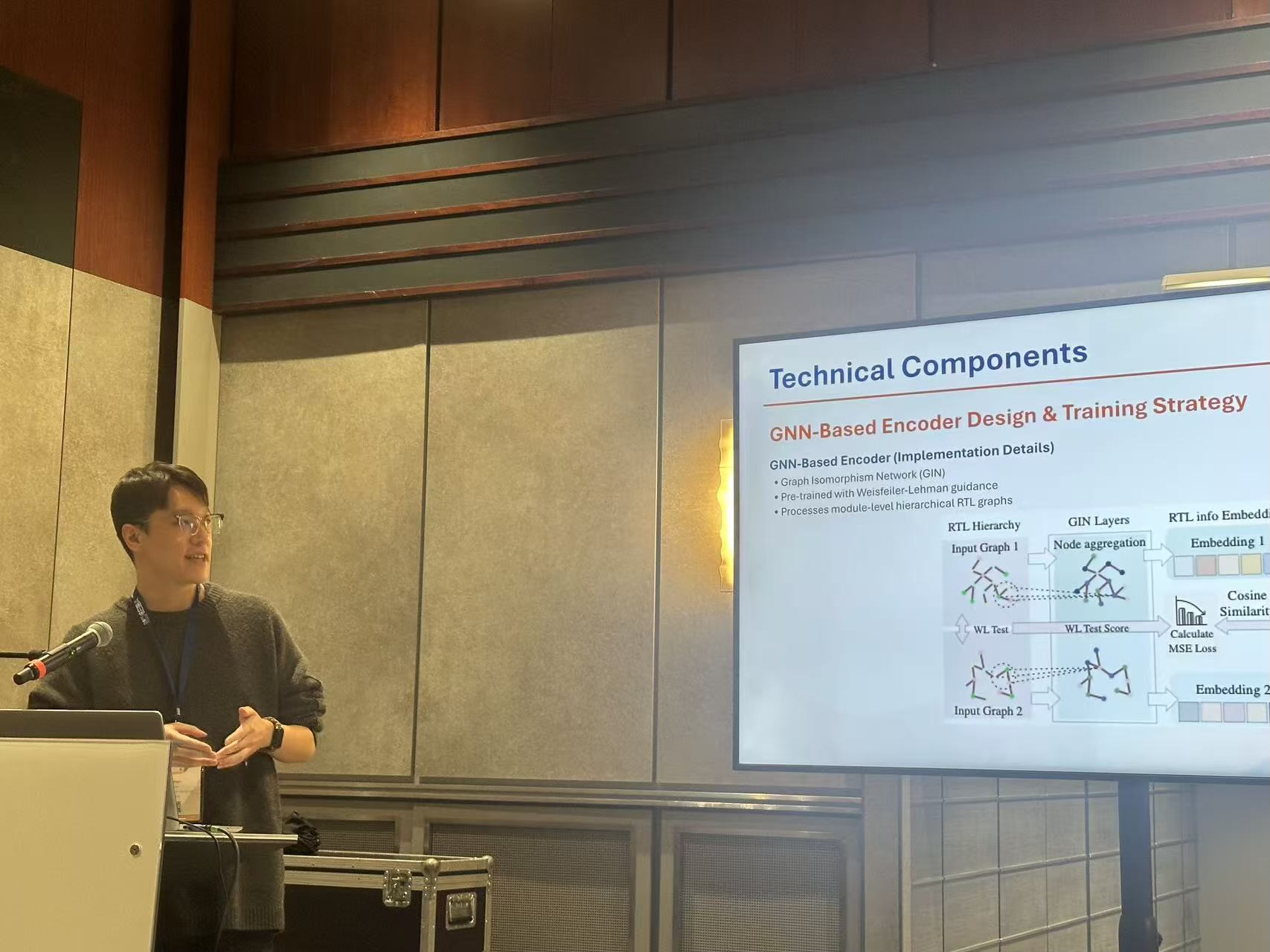

我的报告安排在 10 月 28 日上午的 “Accelerating Large Language Models (LLMs)” 分会。这个 session 本身就很有代表性:一方面,它反映出大模型已经不再只是软件和算法社区的话题,而是真正进入了体系结构、EDA 和硬件协同设计的研究视野;另一方面,我的工作虽然落脚点是 SoC design space exploration,但也正好处在这种交叉趋势里。我的论文尝试把自然语言语义信息和 RTL 结构信息结合起来,用多模态方式表示设计点,再结合带不确定性估计的代理模型和贝叶斯优化,提高设计空间探索的效率。简单来说,我想回答的问题是:如果我们不再只把设计参数看成一串离散数字,而是把它背后的语义和结构也纳入建模,是否能更有效地引导探索过程。能在 ICCAD 这样的场合讲这个问题,对我而言是一次非常宝贵的检验。

汇报的过程让我感受到,国际会议最有价值的地方并不只是“展示成果”,而是它会逼着你把工作讲得更清楚。平时在组里讨论时,很多背景默认大家都知道,但在正式报告里,你必须非常明确地解释:问题是什么、为什么重要、方法真正新在哪里、实验结果究竟说明了什么。这次报告也让我重新审视了自己的工作。比如,大家会更关注方法的可推广性、对不同设计场景的适应能力,以及多模态表示到底在什么条件下最有效。这些问题有些我已经考虑过,有些则是在交流之后才意识到还可以继续往前推进。对博士生来说,这种“被迫澄清”的过程其实很重要,它能帮助我从“我做了什么”进一步走向“这项工作在更大研究图景里的位置是什么”。

除了自己的报告之外,这次参会也让我更直观地感受到 AI for EDA 这个方向正在快速升温。会议中不少工作都在讨论大模型、智能代理和硬件设计自动化之间的新联系,但与此同时,大家也很谨慎,并不会因为“LLM”是热点就自动认可一切。相反,很多讨论都回到很扎实的问题:模型是否真的提升了设计效率,是否具备稳定性,能否在有限评估预算下带来可验证的收益。这些讨论让我更加确认,自己未来如果继续做这个方向,不能只停留在“把大模型引进来”,而是要回答它在 EDA 问题里究竟解决了什么、为什么比已有方法更合适。

从个人成长的角度讲,这次在慕尼黑的参会经历也让我更适应把自己放到国际学术语境中去表达。无论是现场报告、会后交流,还是听其他研究者介绍工作,我都更强烈地意识到,研究不是封闭地完成一篇论文,而是在持续对话中逐渐形成判断、修正方向。对我来说,这次 ICCAD 之行的价值,不只是“完成了一次出国参会”,而是让我更清楚地看到自己所做研究与当前学术前沿之间的连接,也让我对接下来的博士阶段研究有了更明确的目标:继续把 SoC 设计空间探索做深,把多模态建模和智能优化真正落到对实际设计有帮助的问题上,争取做出更扎实、也更有说服力的工作。

沪公网安备 31011502006855号

沪公网安备 31011502006855号