我院迎来了一位新教授,她是王雯婕。她有着什么样的学术背景,又在哪个研究领域不断精进?接下来让我们一起了解一下吧!

✦

王雯婕

助理教授、研究员

专业方向:计算机科学与技术

●个人简介 ●

王雯婕博士本科毕业于华中科技大学,师从宁康教授,后在美国Emory University获得博士学位,师从 Prof. Li Xiong。博士期间王雯婕博士曾在腾讯AI实验室(西雅图)和IBM Research进行NLP和Adversarial Machine learning的科研实习。今年2月王雯婕博士加入上海科技大学信息科学与技术学院担任助理教授、研究员、博士生导师。

●研究领域●

王雯婕博士的主要研究领域是人工智能的隐私性和安全性,尤其是在自然语言处理和医疗领域的相关应用,包括联邦学习、差分隐私、对抗样本和可验证鲁棒性。相关工作发表于人工智能及网络安全的国际知名期刊和会议。

●快问快答●

Q1:能简单的描述下您的研究方向吗?

随着人工智能与深度学习理论研究在计算机视觉,自然语言处理,信号处理,数据挖掘等各个领域的不断推进和发展,也带动了深度学习在生产生活中的广泛应用。在人工智能广泛融入生产生活的大背景下, 为了更好地推动数字经济健康有效的发展, 如何提高人工智能的安全性和隐私性成为当前人工智能领域亟待研究和突破的关键问题。

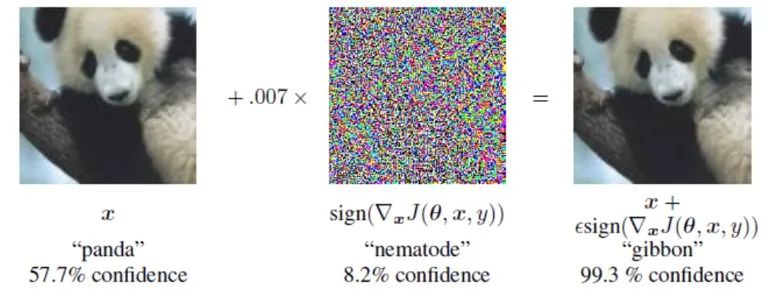

一方面,人工智能系统的安全性研究指的是在模型训练和模型推理过程中如何保证模型的准确性和可靠性, 避免恶意攻击。课题组致力于提升深度模型针对对抗样本和投毒攻击攻防算法及其鲁棒性分析。

对抗样本案例

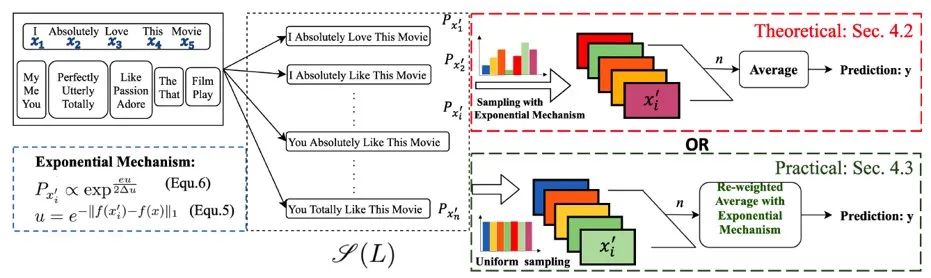

针对文本分类问题的对抗样本的可验证鲁棒性算法

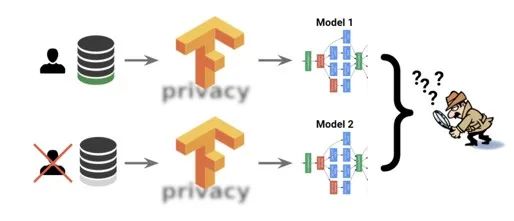

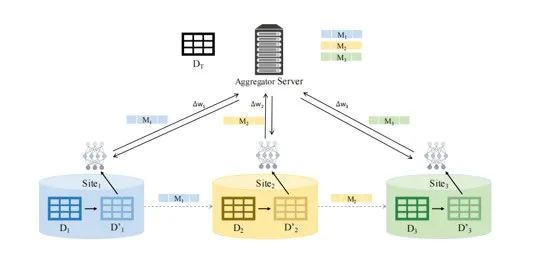

另一方面,人工智能系统的隐私性研究指的是在数据收集存储,数据共享,模型训练和模型推理的过程中如何有效的保护用户数据隐私不泄漏,不被未授权第三方获取或推理。1. 在数据收集,存储和共享阶段, 隐私数据可能被未经授权的人员获取或被共享方不当使用。2. 在模型训练和推理阶段,会涉及典型的机器学习隐私攻击包括成员推理攻击,它们主要攻击目标是通过机器学习模型本身或机器学习模型在预测时的输出,推理某些个体的隐私数据是否在训练集中。课题组致力于将差分隐私算法和联邦学习架构进行融合,尤其是在医疗数据领域的应用,在保证模型性能的基础上更好的保护数据隐私安全。

保护用于训练模型的用户隐私安全

联邦学习:分布式模型训练架构

Q2:您对未来课题组学生有什么期待和规划?

欢迎对人工智能安全性和隐私计算方向感兴趣,希望在学术道路上做出一些有意思的成果的同学与我进行深入的探讨和交流!

Q3:您有哪些方面的兴趣爱好?

体育方面我喜欢打篮球和乒乓球,音乐方面,比较擅长钢琴,也学过一些吉他和架子鼓,毕生心愿是能和志同道合的人们组一支乐队。我也很喜欢小动物,欢迎大家来找我撸猫撸狗。平时也喜欢hiking和barbecue, 希望未来能与同学们一起开展各种有意思的团建!

Q4:您有什么话想对未来的学生们说?

科研的道路绝非一帆风顺,相较于天资聪颖,我更相信持之以恒,脚踏实地,百折不挠的人能走的更远。面对挫折的心态,自信但不自负的态度,对自我清晰的认知这些宝贵的品质不仅仅决定了学习工作上的成败,也是非常重要的人生财富。希望各位学生可以明确自己的兴趣方向,然后坚持下去,大量阅读积累知识,并时常整理归纳,培养逻辑思考的能力和习惯,虽然过程可能伴随着痛苦和挣扎,但是每次小小的突破和进步也会给你巨大的喜悦和回馈。作为老师,我会给大家最大的帮助,无论是学习上或是人生道路上,欢迎大家共同探讨共同进步。

沪公网安备 31011502006855号

沪公网安备 31011502006855号